内容简介:

生成对抗网络(GAN)是训练模型的新思想,生成器和鉴别器相互对抗以提高生成质量。最近,GAN在图像生成方面取得了惊人的成果,并在此基础上迸发发了大量新的思想,技术和应用。虽然只有少数成功的案例,但GAN在文本和语音领域具有很大的潜力,以克服传统方法的局限性。

本教程分为三个部分。在第一部分中,我们将介绍生成对抗网络(GAN)并提供有关此技术的全面介绍。在第二部分中,我们将重点介绍GAN在语音信号处理中的应用,包括语音增强,语音转换,语音合成,以及域对抗训练在说话人识别和唇读等方面的应用。在第三部分中,我们将描述GAN生成句子的主要挑战,并回顾一系列应对挑战的方法。同时,我们将提出使用GAN实现文本样式转换,机器翻译和抽象摘要的算法,而无需配对数据。

讲者简介: 李宏毅教授分别于2010年和2012年在国立台湾大学获得了硕士与博士学位。2012年9月至2013年8月,他是中国科学院信息技术创新研究中心的博士后。2013年9月至2014年7月,他是麻省理工学院计算机科学与人工智能实验室(CSAIL)语言系统组的访问科学家。现任国立台湾大学电气工程系助理教授,并任职于该大学计算机科学与信息工程系。他的研究重点是机器学习(尤其是深度学习),口语理解和语音识别。

曹昱副研究员分别于1999年和2001年获得台湾大学电子工程学士学位和硕士学位。他于2008年获得佐治亚理工学院电气与计算机工程博士学位. 2009至2011年,曹博士是日本国家信息与通信技术研究所(NICT)的研究员,从事自动语音研究和产品开发,识别多语言语音到语音翻译。目前,他是台湾台北中央研究院信息技术创新研究中心(CITI)的副研究员。他于2017年获得了中央研究院职业发展奖。曹博士的研究兴趣包括语音和说话人识别,声学和语言建模,音频编码和生物信号处理。

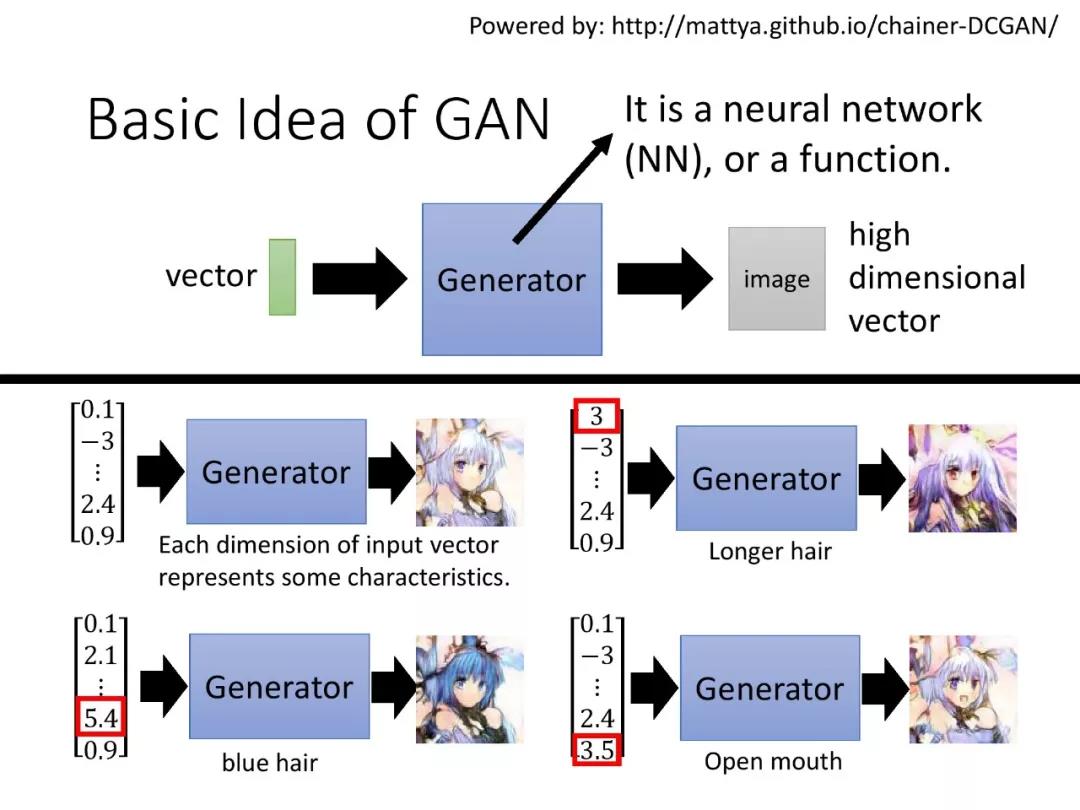

目录: GAN的基本思想及一些基础的理论知识

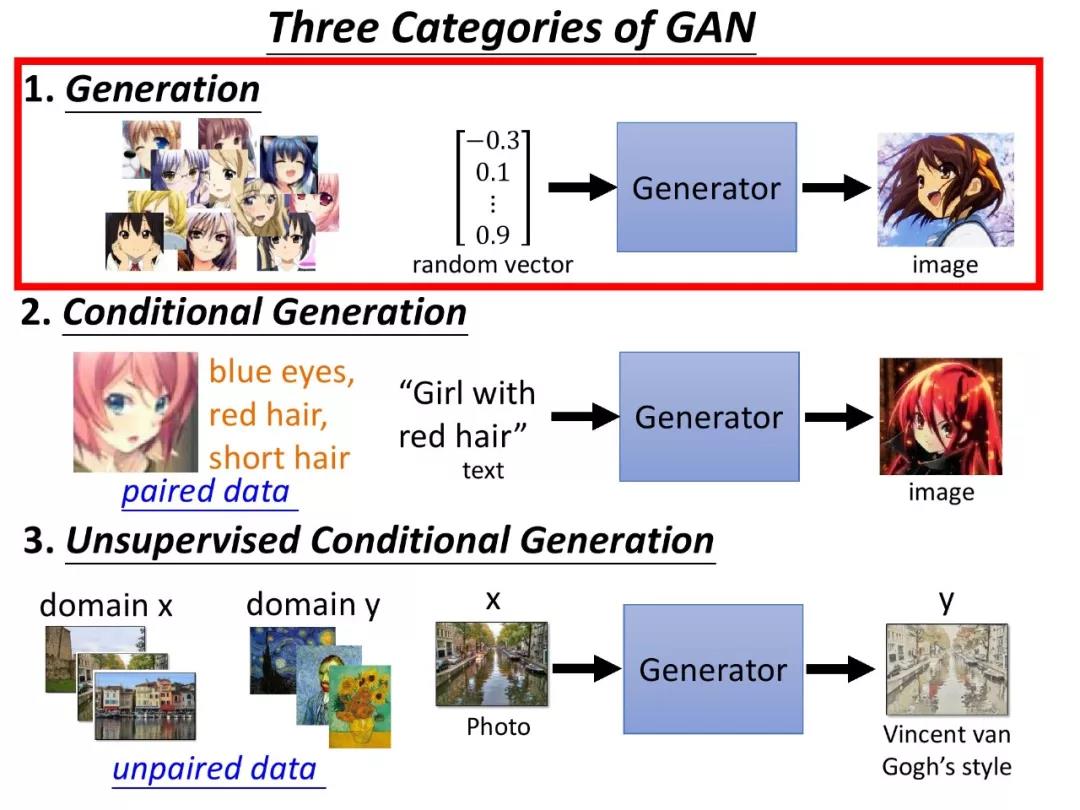

- GAN的三种类别

- GAN的基本理论

- 一些有用的技巧

- 如何评估GAN

- 与强化学习的关系

GAN在语音方面的应用

- 语音信号生成

- 语音信号识别

- 结论

GAN在自然语言处理方面的应用

- GAN序列生成

- 无监督条件序列生成