【泡泡一分钟】对基于循环神经网络(RNN)框架叠加下异常检测的稀疏编码方法的再研究(ICCV2017-33)

每天一分钟,带你读遍机器人顶级会议文章

标题:A Revisit of Sparse Coding Based Anomaly Detection in Stacked RNN Framework

作者:Weixin Luo, Wen Liu, Shenghua Gao

来源:International Conference on Computer Vision (ICCV 2017)

播音员:丸子

编译:王少博 周平(36)

欢迎个人转发朋友圈;其他机构或自媒体如需转载,后台留言申请授权

摘要

基于异常检测在稀疏编码中的优良表现,我们提出了一种时间相关稀疏编码方法,其中我们对相似的相邻帧用相似的重建系数进行编码,之后我们将特殊叠加类型的循环神经网络与时间相关稀疏编码进行映射和匹配。

通过sRNN可以同时学习参数的这一特点,可以有效避免时间相关稀疏编码的非平凡超参数选择问题。同时,使用深度较浅的sRNN,可以在正向通道内推断重建系数,这降低了学习稀疏系数的计算成本。

本文的贡献主要有以下两个方面:第一个是,我们提出了时间相关稀疏编码方法,它可以映射到sRNN中更方便地进行参数优化并加速了异常检测;二是我们建立了一个非常大的数据集用于异常检测,它甚至比所有现在数据集的总和还要大,无论是根据数据的体量还是数据场景的多样化,我们在虚拟和真实的数据集上进行了扩展实验,证明了我们的方法始终优于现有方法,验证了方法的有效性。

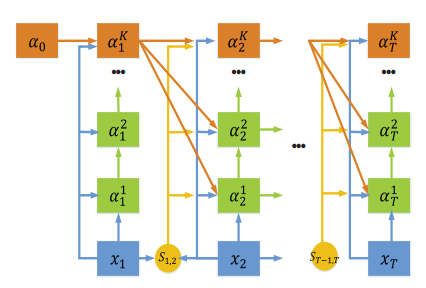

上图是时间相关稀疏编码的拓扑示意图

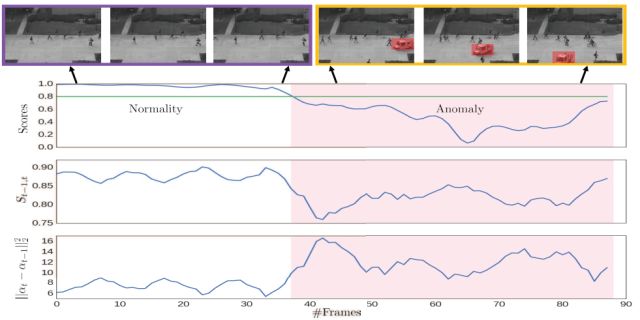

上图是本文算法在实际数据集中的应用

Abstract

Motivated by the capability of sparse coding based anomaly detection, we propose a Temporally-coherent Sparse Coding (TSC) where we enforce similar neighbouring frames be encoded with similar reconstruction coefficients. Then we map the TSC with a special type of stacked Recurrent Neural Network (sRNN). By taking advantage of sRNN in learning all parameters simultaneously, the nontrivial hyper-parameter selection to TSC can be avoided, meanwhile with a shallow sRNN, the reconstruction coefficients can be inferred within a forward pass, which reduces the computational cost for learning sparse coefficients. The contributions of this paper are two-fold: i) We propose a TSC, which can be mapped to a sRNN which facilitates the parameter optimization and accelerates the anomaly prediction. ii) We build a very large dataset which is even larger than the summation of all existing dataset for anomaly detection in terms of both the volume of data and the diversity of scenes. Extensive experiments on both a toy dataset and real datasets demonstrate that our TSC basedand sRNN based method consistently outperform existing methods, which validates the effectiveness of our method.

如果你对本文感兴趣,想要下载完整文章进行阅读,可以关注【泡泡机器人SLAM】公众号(paopaorobot_slam)。

欢迎来到泡泡论坛,这里有大牛为你解答关于SLAM的任何疑惑。

有想问的问题,或者想刷帖回答问题,泡泡论坛欢迎你!

泡泡网站:www.paopaorobot.org

泡泡论坛:http://paopaorobot.org/forums/

泡泡机器人SLAM的原创内容均由泡泡机器人的成员花费大量心血制作而成,希望大家珍惜我们的劳动成果,转载请务必注明出自【泡泡机器人SLAM】微信公众号,否则侵权必究!同时,我们也欢迎各位转载到自己的朋友圈,让更多的人能进入到SLAM这个领域中,让我们共同为推进中国的SLAM事业而努力!

商业合作及转载请联系liufuqiang_robot@hotmail.com