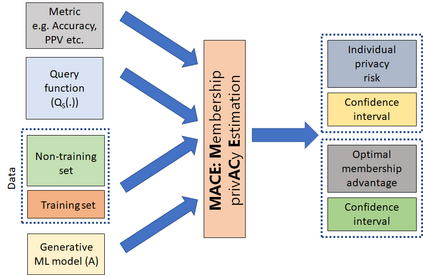

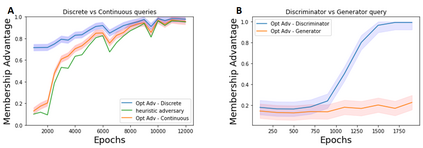

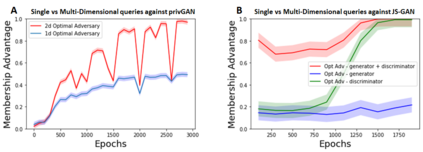

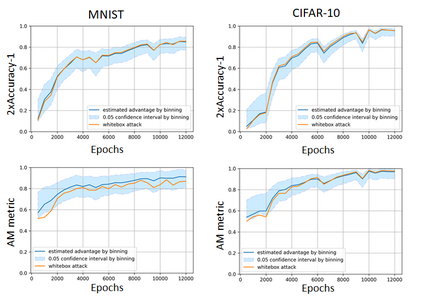

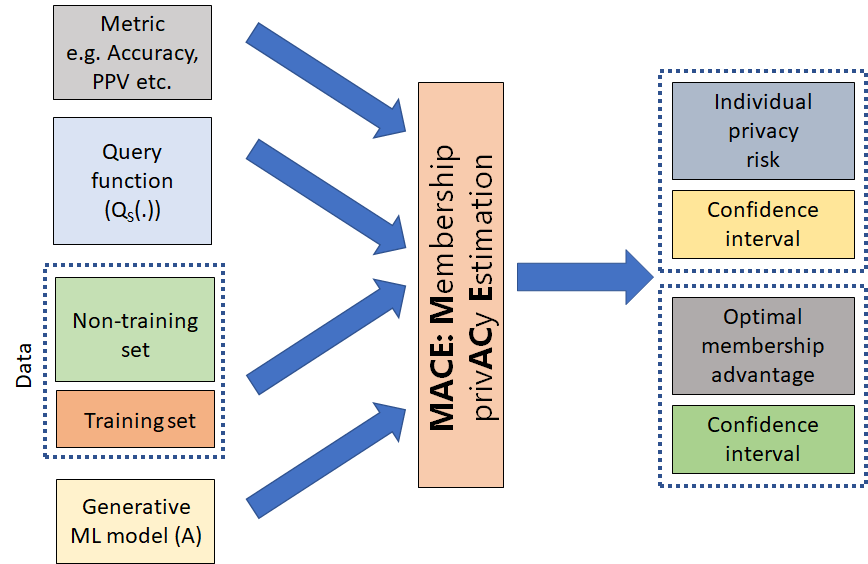

In this work, we formally study the membership privacy risk of generative models and propose a membership privacy estimation framework. We formulate the membership privacy risk as a statistical divergence between training samples and hold-out samples, and propose sample-based methods to estimate this divergence. Unlike previous works, our proposed metric and estimators make realistic and flexible assumptions. First, we offer a generalizable metric as an alternative to accuracy for imbalanced datasets. Second, our estimators are capable of estimating the membership privacy risk given any scalar or vector valued attributes from the learned model, while prior work require access to specific attributes. This allows our framework to provide data-driven certificates for trained generative models in terms of membership privacy risk. Finally, we show a connection to differential privacy, which allows our proposed estimators to be used to understand the privacy budget 'epsilon' needed for differentially private generative models. We demonstrate the utility of our framework through experimental demonstrations on different generative models using various model attributes yielding some new insights about membership leakage and vulnerabilities of models.

翻译:在这项工作中,我们正式研究基因模型的成员隐私风险,并提议一个成员隐私估算框架。我们把成员隐私风险作为培训样本和搁置样本之间的统计差异来制定,并提出基于样本的方法来估计这一差异。与以前的工作不同,我们提议的衡量标准和估计者提出了现实和灵活的假设。首先,我们提供了一个通用的衡量标准,以替代不平衡的数据集的准确性。第二,我们的估测者能够根据所学模型中任何标值或矢量值的属性来估计成员隐私风险,而先前的工作则需要获得特定属性。这使我们的框架能够提供以数据驱动的证书,用于在成员隐私风险方面对经过训练的基因模型进行数据驱动的认证。最后,我们显示了与差异隐私的联系,使我们提议的估算者能够用来理解差异性私人基因模型所需的隐私预算“普及”。我们通过实验示范不同基因模型,展示了我们框架的效用,通过实验演示不同基因模型,对成员流失和模型的脆弱性产生一些新的见解。