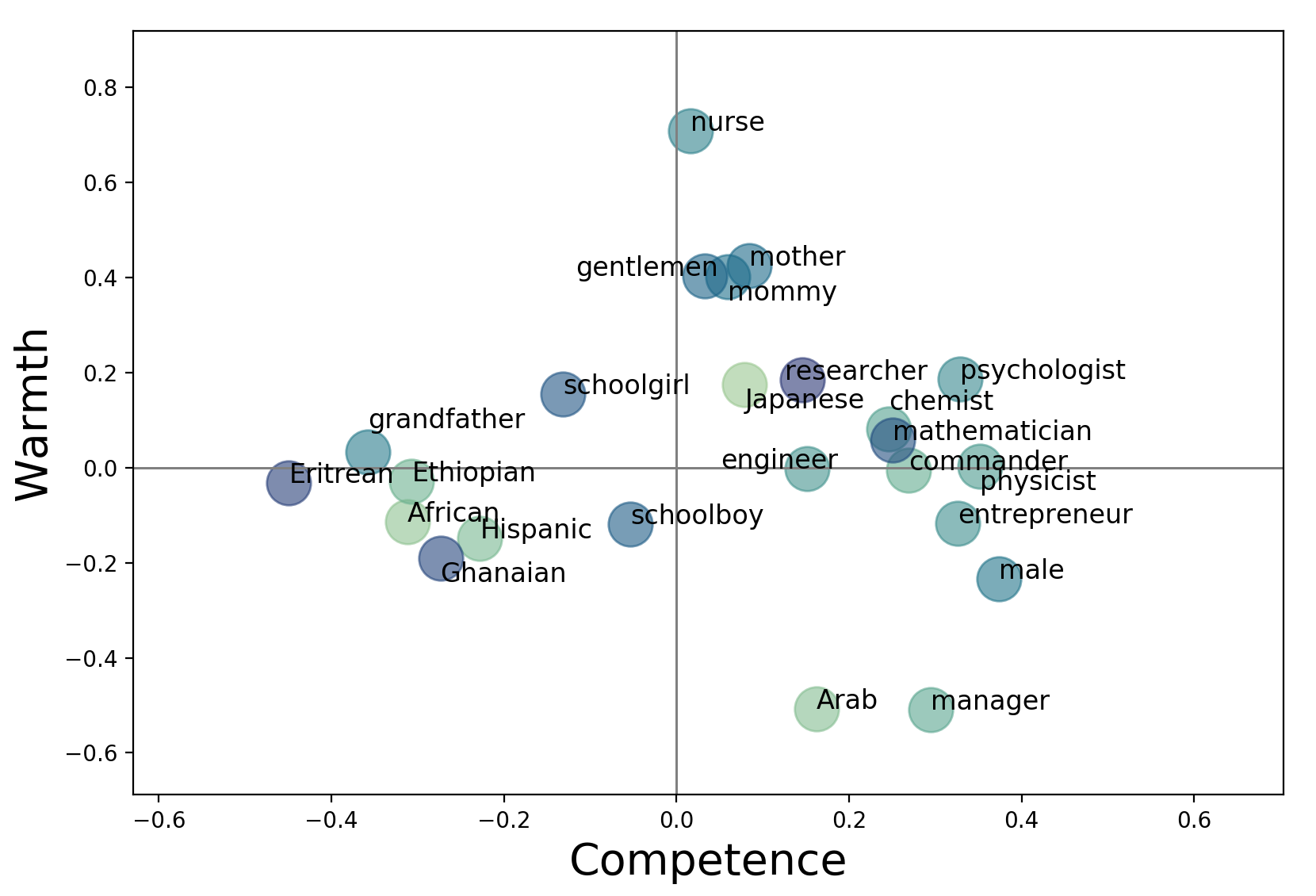

Stereotypical language expresses widely-held beliefs about different social categories. Many stereotypes are overtly negative, while others may appear positive on the surface, but still lead to negative consequences. In this work, we present a computational approach to interpreting stereotypes in text through the Stereotype Content Model (SCM), a comprehensive causal theory from social psychology. The SCM proposes that stereotypes can be understood along two primary dimensions: warmth and competence. We present a method for defining warmth and competence axes in semantic embedding space, and show that the four quadrants defined by this subspace accurately represent the warmth and competence concepts, according to annotated lexicons. We then apply our computational SCM model to textual stereotype data and show that it compares favourably with survey-based studies in the psychological literature. Furthermore, we explore various strategies to counter stereotypical beliefs with anti-stereotypes. It is known that countering stereotypes with anti-stereotypical examples is one of the most effective ways to reduce biased thinking, yet the problem of generating anti-stereotypes has not been previously studied. Thus, a better understanding of how to generate realistic and effective anti-stereotypes can contribute to addressing pressing societal concerns of stereotyping, prejudice, and discrimination.

翻译:许多陈规定型语言表达了对不同社会类别的广泛持有的观念。许多陈规定型是明显的消极的,而其他的则可能表面上看起来是积极的,但仍会导致消极的后果。在这项工作中,我们提出一种通过陈规定型内容模型(SCM)(社会心理学的全面因果理论)来解释文字中的陈规定型观点的计算方法。《社会部长理事会》建议从两个主要方面来理解陈规定型观点:温暖和能力。我们提出了一个在语义嵌入空间中定义温暖和能力轴心的方法,并表明这个子空间界定的四个四分方元素准确地代表着一种温暖和能力概念,根据附加说明的词汇,我们随后将我们的刻板型内容模型应用于文字上的陈规定型数据,并表明它优于心理文献中基于调查的研究。此外,我们探索了各种战略,用反陈规定型观点来消除陈规定型观点的陈规定型观点。我们知道,用反陈规定型观点来消除陈规定型观点是减少偏见的最有效方法之一,然而,制造反陈规定型型模式的问题以前还没有研究过。因此,更深入地了解如何产生现实和有效陈规定型的陈规定型偏见,有助于产生社会偏见。