主题: Interpretable survival gradient boosting models with bagged trees base learners

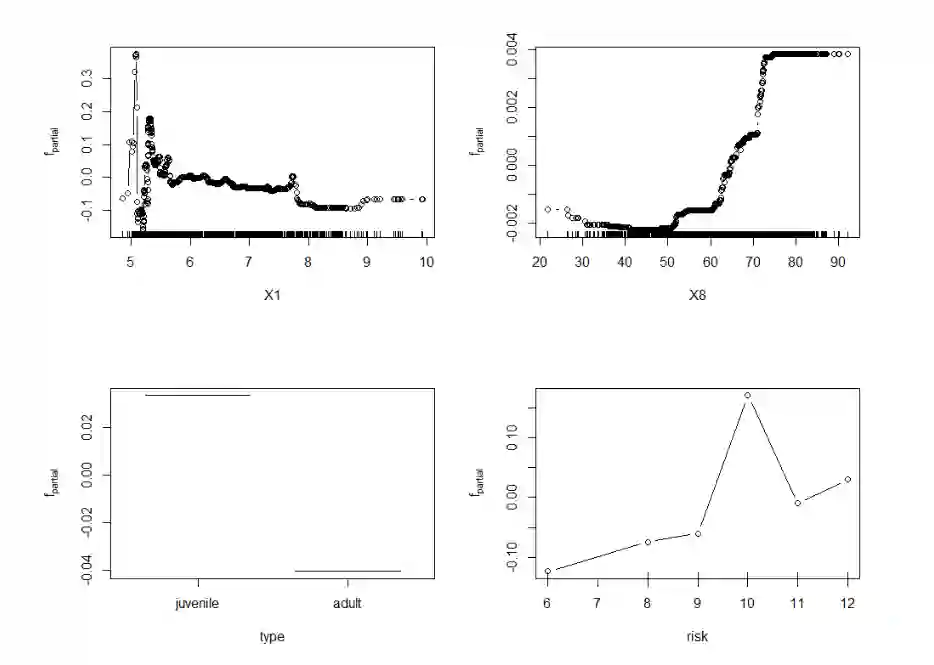

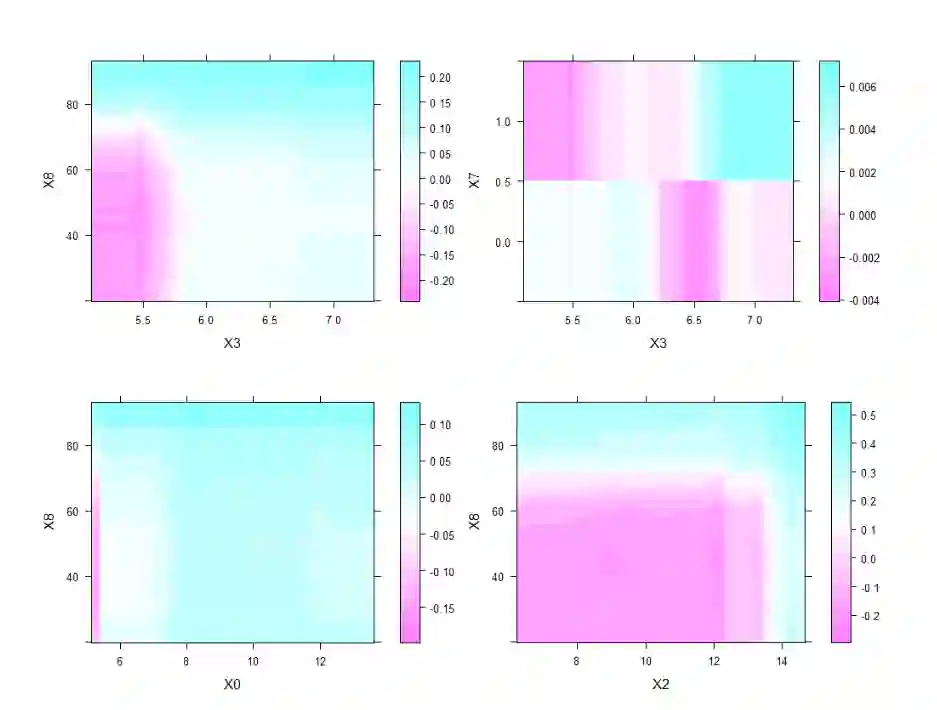

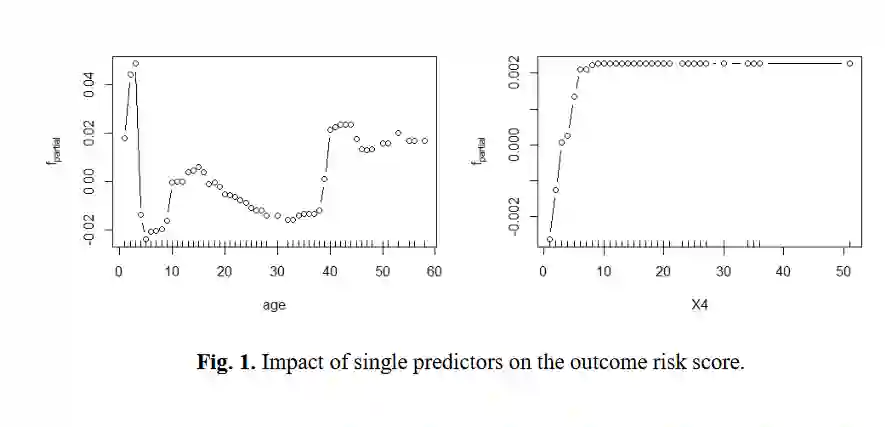

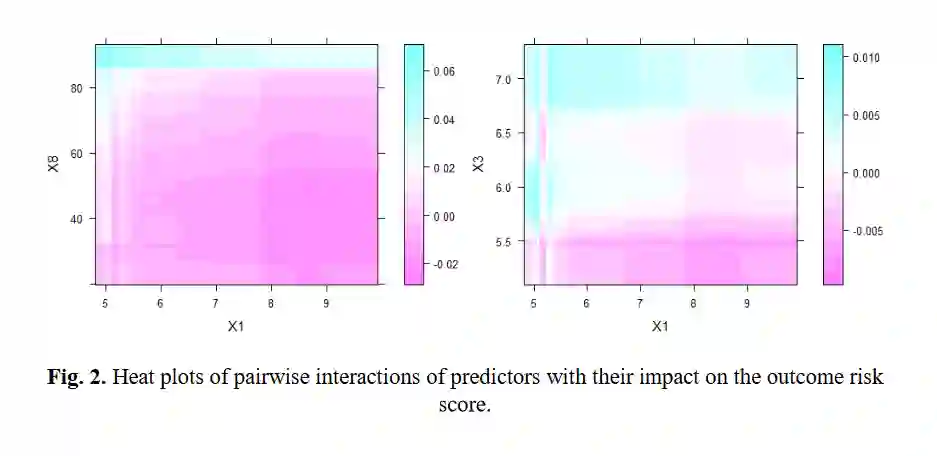

摘要: 本文提出了一种以bagged trees为基础学习的基于ongradient-boosting的生存分析建模方法,该方法由单变量模型的可加性成分和它们之间的交互作用组成,使得模型具有直观的可解释性。我们表明,我们的方法产生竞争力的结果往往具有预测能力高于全复杂模型。

成为VIP会员查看完整内容

相关内容

专知会员服务

32+阅读 · 2020年6月11日

专知会员服务

13+阅读 · 2020年4月16日

专知会员服务

49+阅读 · 2020年1月1日