摘要:

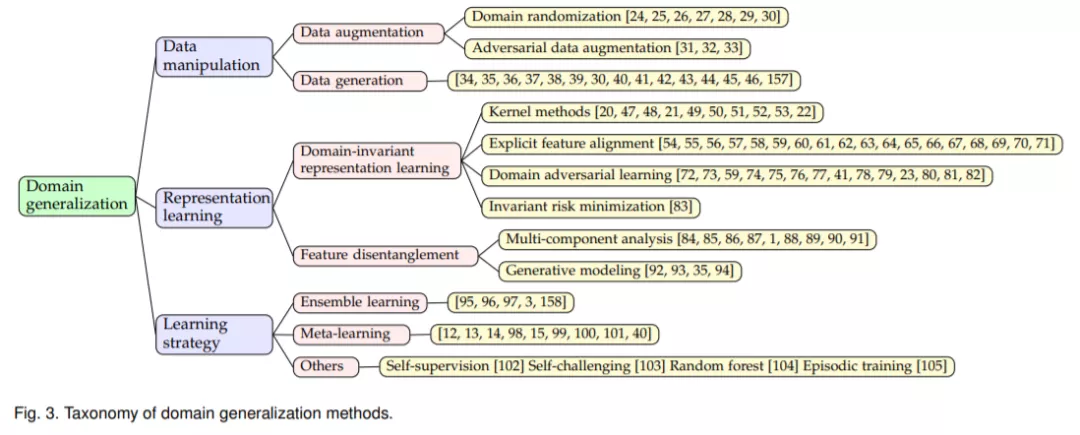

域泛化(DG),即分布外泛化,近年来引起了越来越多的关注。领域泛化处理一个具有挑战性的设置,其中给出了一个或几个不同但相关的领域,目标是学习一个可以泛化到看不见的测试领域的模型。近年来,取得了很大的进展。本文首次综述了领域泛化的最新进展。首先,我们给出了领域泛化的形式化定义,并讨论了几个相关的领域。接下来,我们对领域泛化的相关理论进行了全面的回顾,并对泛化背后的理论进行了仔细的分析。然后,我们将最近出现的算法分为三类,分别是数据操作、表示学习和学习策略,每一类都包含了一些流行的算法。第三,介绍了常用的数据集及其应用。最后,对已有文献进行了总结,并提出了未来的研究方向。

https://www.zhuanzhi.ai/paper/5b8b8958327cabc8b6694d7fc5c7ac75

引言

机器学习(ML)在计算机视觉、自然语言处理和医疗保健等各个领域都取得了显著的成功。ML的目标是设计一个可以从训练数据中学习通用和预测性知识的模型,然后将该模型应用于新的(测试)数据。

传统的ML模型训练基于i.i.d.假设,训练数据和测试数据是相同的,独立分布的。然而,这种假设在现实中并不总是成立的。当训练数据和测试数据的概率分布不同时,由于域分布的差异,ML模型的性能往往会下降。收集所有可能领域的数据来训练ML模型是昂贵的,甚至是不可能的。因此,提高ML模型的泛化能力具有重要的工业和学术意义。

与广义相关的研究课题有很多,如领域适应、元学习、迁移学习、协变量转移等。近年来,领域泛化(DG)受到了广泛的关注。如图1所示,领域泛化的目标是从一个或几个不同但相关的领域(即不同的训练数据集)学习模型,这些领域将在看不见的测试领域上很好地泛化。

图片

近年来,领域泛化在计算机视觉、自然语言处理等领域取得了长足的进展。除此之外,目前还没有一项关于该领域的调查能够全面介绍和总结其主要思想、学习算法等相关问题,为未来的研究提供见解。

本文首先介绍了领域泛化的研究概况,重点介绍了领域泛化的公式、理论、算法、数据集、应用以及未来的研究方向。希望本研究能为相关研究者提供一个全面的回顾,并对相关领域的研究有所启发。

本文的结构组织如下。我们将在第2节中阐述领域概括并讨论其与现有研究领域的关系。第3节介绍了领域泛化的相关理论。在第4节中,我们详细描述了有代表性的DG方法。第5节介绍了应用程序,第6节介绍了DG的基准数据集。我们在第7节中总结了现有工作的见解,并提出了一些可能的未来方向。最后,在第8节对本文进行总结。

方法体系

领域泛化方法是我们的核心。本文将已有的领域泛化方法按照数据操作、表示学习、学习策略分为三大方面,如下图所示。

数据操作,指的是通过对数据的增强和变化使训练数据得到增强。这一类包括数据增强和数据生成两大部分。

表示学习,指的是学习领域不变特征(Domain-invariant representation learning)以使得模型对不同领域都能进行很好地适配。领域不变特征学习方面主要包括四大部分:核方法、显式特征对齐、领域对抗训练、以及不变风险最小化(Invariant Risk Minimiation, IRM)。特征解耦与领域不变特征学习的目标一致、但学习方法不一致,我们将其单独作为一大类进行介绍。 学习策略,指的是将机器学习中成熟的学习模式引入多领域训练中使得模型泛化性更强。这一部分主要包括基于集成学习和元学习的方法。同时,我们还会介绍其他方法,例如自监督方法在领域泛化中的应用。