题目

跨语言表示学习,Unsupervised Cross-lingual Representation Learning at Scale

关键词

自然语言处理,表示学习,跨语言,人工智能

简介

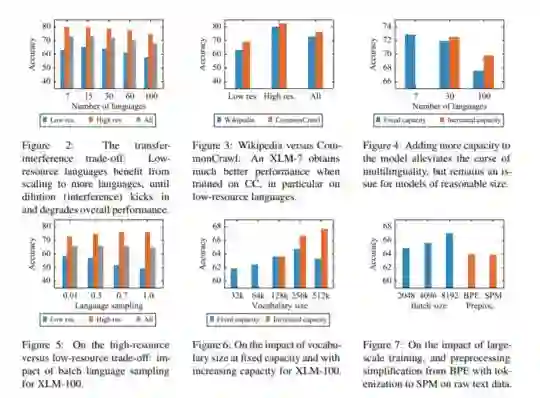

本文表明,针对多种跨语言转换任务,大规模地对多语言语言模型进行预训练可以显着提高性能。 我们使用超过2 TB的经过过滤的CommonCrawl数据在一百种语言上训练了基于Transformer的屏蔽语言模型。 我们的模型称为XLM-R,在各种跨语言基准测试中,其性能明显优于多语言BERT(mBERT),包括XNLI的平均精度为+ 13.8%,MLQA的平均F1得分为+ 12.3%,NER的平均F1得分为+ 2.1%。 XLM-R在低资源语言上表现特别出色,与以前的XLM模型相比,斯瓦希里语的XNLI准确性提高了11.8%,乌尔都语的准确性提高了9.2%。 我们还对获得这些收益所需的关键因素进行了详细的实证评估,包括(1)积极转移和能力稀释以及(2)大规模资源资源的高低性能之间的权衡。 最后,我们首次展示了在不牺牲每种语言性能的情况下进行多语言建模的可能性。 XLM-R在GLUE和XNLI基准测试中具有强大的单语言模型,因此非常具有竞争力。 我们将公开提供XLM-R代码,数据和模型。

作者

Alexis Conneau, Kartikay Khandelwal等。

成为VIP会员查看完整内容

相关内容

专知会员服务

42+阅读 · 2020年4月11日

专知会员服务

14+阅读 · 2019年11月11日