“花书”的佐餐,你的线性代数笔记

原作:Hadrien Jean

线性栗子 编译自 GitHub

量子位 出品 | 公众号 QbitAI

最近,巴黎高等师范学院的博士生Hadrien Jean,整理了关于深度学习“花书”的一套笔记,还有幸在推特上被Ian Goodfellow老师翻了牌。

这份笔记是针对“花书”的线性代数一章,快要毕业的Jean希望初来乍到的小朋友们,可以在笔记的辅佐之下,了解深度学习里最常用的数学理论,并加以轻松的支配。

要解锁自己的数据科学技能,或许就要从线性代数开始。而对于深度学习领域的大家,如果把理论和代码搭配食用,疗效可能会更好。

而Jean在笔记里列举的各种例子,可以帮助初学者用一种更直观且实用的方式,学好线代。要跟住他的脚步,可能需要准备好Numpy和Python。

现在,我们来看一下,这份笔记走的是怎样一个疗程——

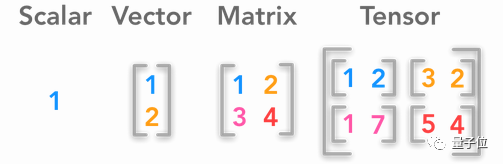

1 标量、向量、矩阵和张量

△ 标量,向量,矩阵,张量 (左起)

这一课讲了向量和矩阵,以及它们的一些基础运算。另外,这里介绍了Numpy的一些相关函数,也浅浅地谈到了Broadcasting机制。

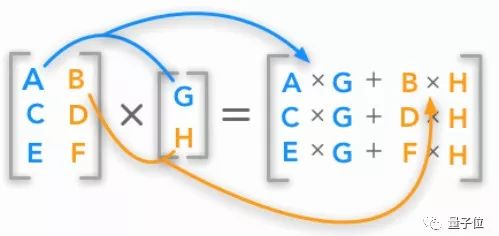

2 矩阵和向量的乘法

△ 矩阵与向量的点乘

本小节主要讨论的是,向量和矩阵的点积,我们可以从中了解矩阵的一些属性。之后,便是用矩阵符号来创建一个线性方程组——这也是日后的学习里,经常要做的事情。

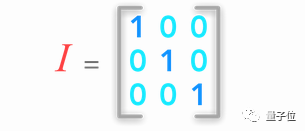

3 单位矩阵和逆矩阵

我们要了解这两种矩阵为什么重要,然后知道怎样在Numpy里和它们玩耍。另外,本小节包含用逆矩阵求解线性方程组的一个例题。

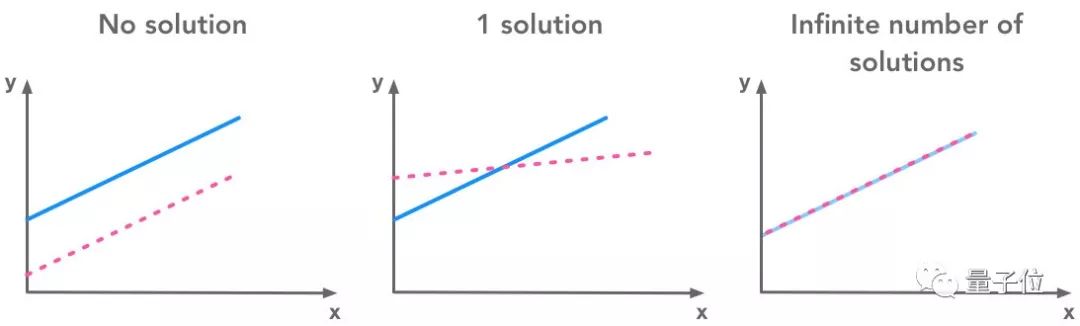

4 线性依赖与线性生成空间

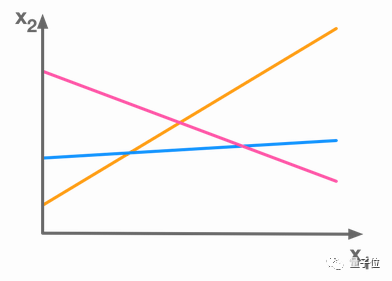

线性方程组,除非无解,不然要么有唯一解,要么有无穷多解。

看着图像,我们可能更直观地了解,这件看上去理所当然的事情,背后的道理是什么。

回到方程组的矩阵形式,感受Gilbert Strang说的“横看成岭侧成峰”——竖看几个方程,横看一个方程里的多个系数。

然后,我们要理解什么是线性组合,还会看到关于超定和欠定方程组的几个例子。

5 范数

向量的范数是个函数,将一个向量输入,我们就得到一个正值——可以把它看做向量的长度。

范数可以用来衡量模型预测值与实际值之间的距离。

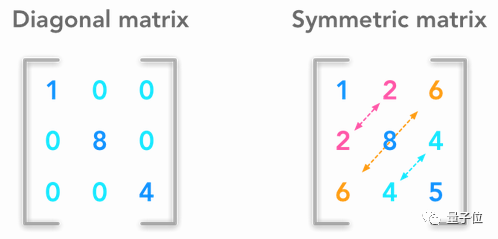

6 特殊的矩阵和向量

一些矩阵和向量,会有和普通矩阵/向量不一样的有趣特性。虽然,这个小节不长,但对理解后面的内容会有帮助。

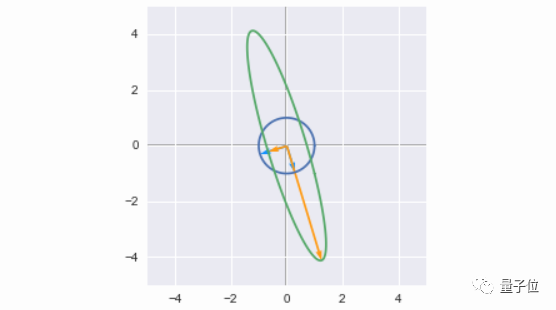

7 特征分解

这里,有线性代数的一些主要概念。我们可以对特征向量和特征值,有一个初步的了解。

大家将会看到,矩阵并不像外表那样单调,它们可以作为线性变换的工具。用一个矩阵对它的特征向量做些加工,便会得到方向相同的新向量。

△ 特征向量 (蓝箭头) ,线性变换后的向量 (黄箭头)

然后,矩阵还可以用来表示二次函数。利用矩阵的特征分解,可以找到对应函数的最大值和最小值。

如果坚持读到这个小节,就可以解锁用Python将线性变换可视化的操作。

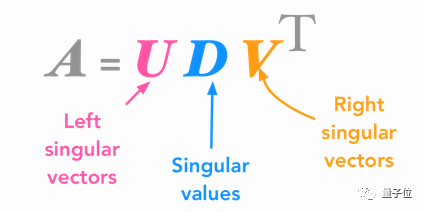

8 奇异值分解 (SVD)

这是除了特征值分解之外的,另一种矩阵分解方式。SVD是将一个矩阵,分解到三个新矩阵里面。

依照“将矩阵看做空间的线性变换”这一理念,我们可以将这些新的矩阵,当做空间的子变换——变换并非一步达成,而是经过了三个分解动作。

走到这里,就可以捡起“将SVD用于图像处理”的新装备。

9 摩尔-彭若斯伪逆

在研究矩阵的路上,我们会遇到不同的风景。

并不是所有矩阵都有自己的逆矩阵。不幸之处不在于孤独,而在于逆矩阵可以用来解方程组。方程组无解的时候,也就没有逆矩阵。

不过,如果将误差最小化,我们也可以找到一个很像解的东西。伪逆便是用来找假解的。

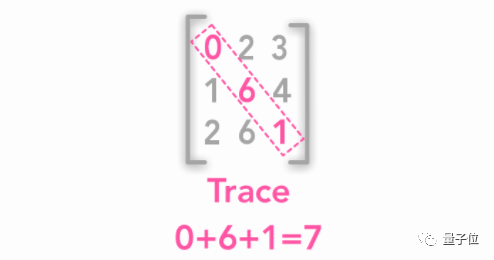

10 迹

△ 矩阵的迹

上图就是矩阵的迹。后面讲到主成分分析 (PCA) 的时候,会需要这个看上去不怎么厉害的东西。

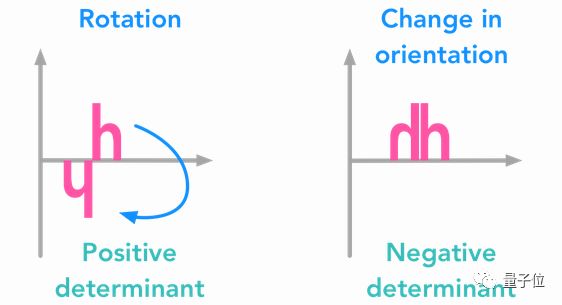

11 行列式

行列式是一个奇妙的数值,可以告诉我们关于矩阵的很多秘密。

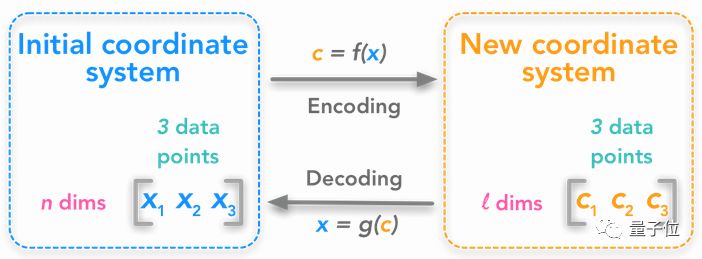

12 主成分分析 (PCA) 例题

恭喜大家来到线性代数的最后一课。

用上前十一课传授的全部技能,便能掌握这一数据分析重要工具的使用方法。

虽然,我还没有非常了解,用Python和Numpy学线代,会是怎样一种愉快的体验。不过,这份笔记看去有几分软妹,图片配色和我学线代那年所见的硬汉画风截然不同,相信初学者的各位也会很有食欲的。

据说,“花书”和春天更配哦。

全套笔记真容在此:

https://hadrienj.github.io/posts/

花书线代章节在此:

http://www.deeplearningbook.org/contents/linear_algebra.html

— 完 —

活动推荐

△ 点击图片或阅读原文

即可获取更多详情

联想高校AI精英挑战赛,覆盖全国28个省份、8大赛区和260所高校,经过在中科大、华中科技大学、清华大学、上海交通大学等8所AI领域具有顶尖优势的理工科高校的半决赛路演,产生最终入围总决赛的十支参赛队伍,并将于3月29日在北京中国科学院计算技术研究所迎来全国总决赛。

加入社群

量子位AI社群15群开始招募啦,欢迎对AI感兴趣的同学,加小助手微信qbitbot6入群;

此外,量子位专业细分群(自动驾驶、CV、NLP、机器学习等)正在招募,面向正在从事相关领域的工程师及研究人员。

进群请加小助手微信号qbitbot6,并务必备注相应群的关键词~通过审核后我们将邀请进群。(专业群审核较严,敬请谅解)

诚挚招聘

量子位正在招募编辑/记者,工作地点在北京中关村。期待有才气、有热情的同学加入我们!相关细节,请在量子位公众号(QbitAI)对话界面,回复“招聘”两个字。

量子位 QbitAI · 头条号签约作者

վ'ᴗ' ի 追踪AI技术和产品新动态