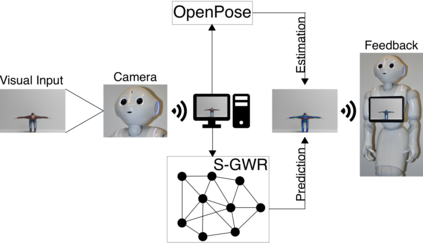

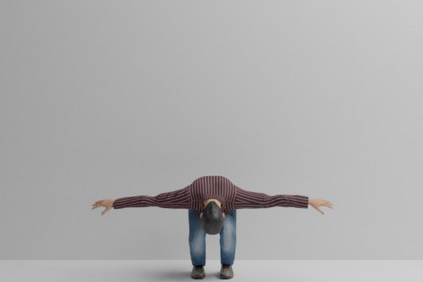

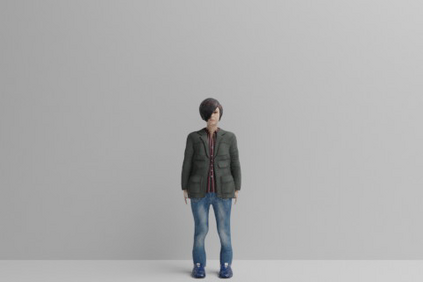

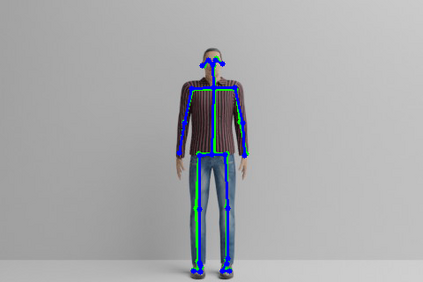

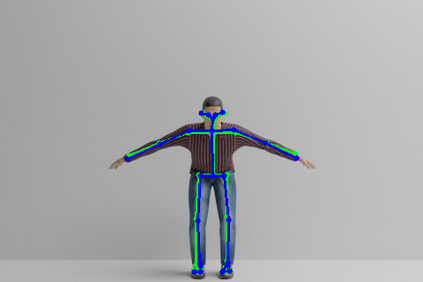

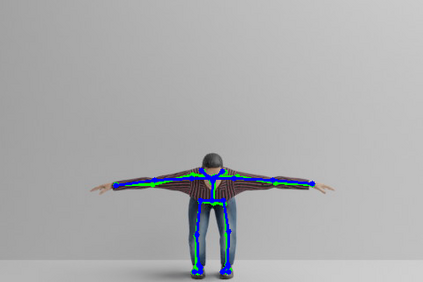

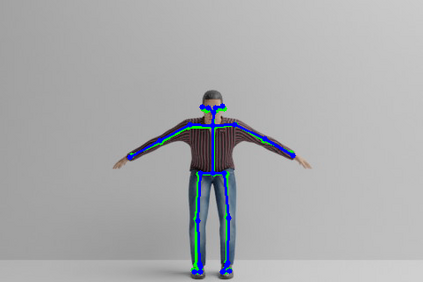

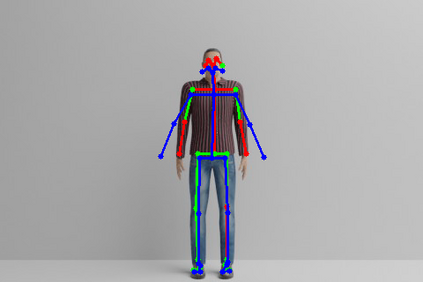

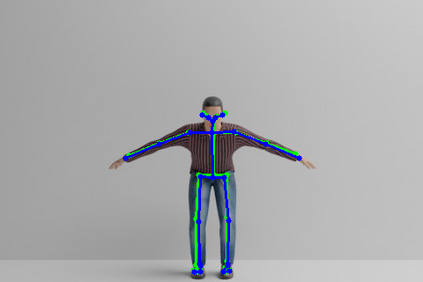

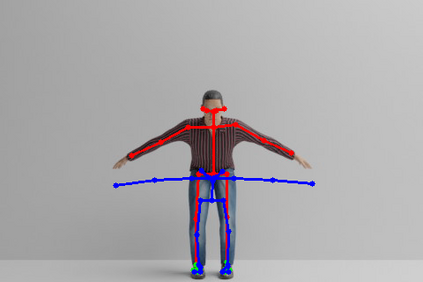

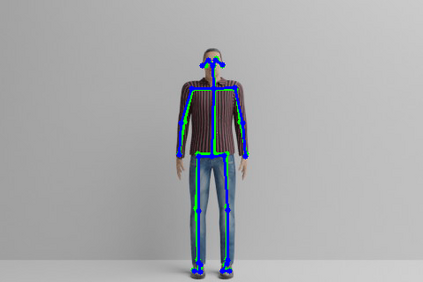

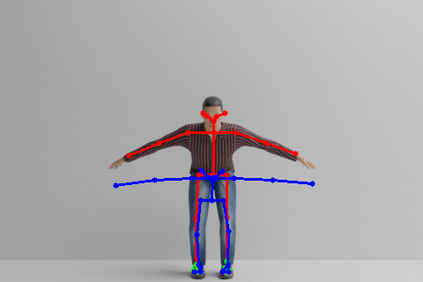

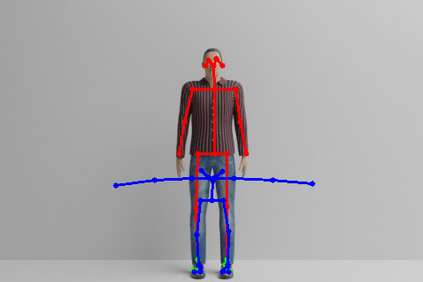

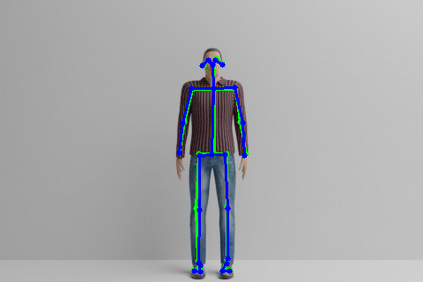

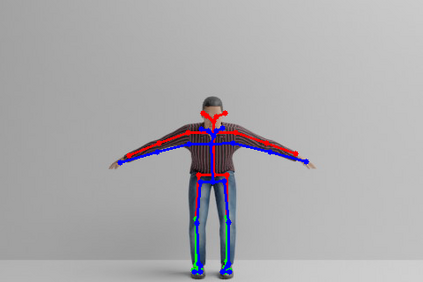

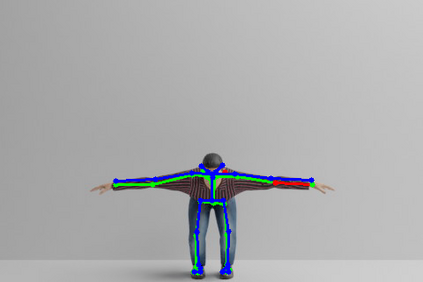

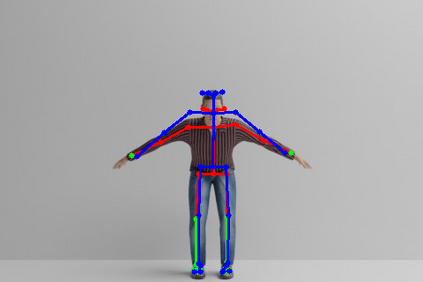

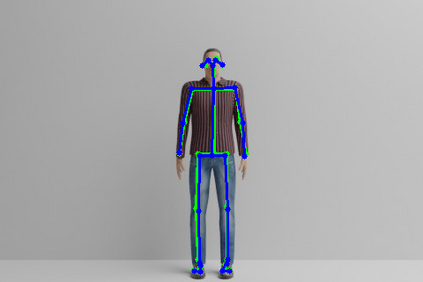

In order to detect and correct physical exercises, a Grow-When-Required Network (GWR) with recurrent connections, episodic memory and a novel subnode mechanism is developed in order to learn spatiotemporal relationships of body movements and poses. Once an exercise is performed, the information of pose and movement per frame is stored in the GWR. For every frame, the current pose and motion pair is compared against a predicted output of the GWR, allowing for feedback not only on the pose but also on the velocity of the motion. In a practical scenario, a physical exercise is performed by an expert like a physiotherapist and then used as a reference for a humanoid robot like Pepper to give feedback on a patient's execution of the same exercise. This approach, however, comes with two challenges. First, the distance from the humanoid robot and the position of the user in the camera's view of the humanoid robot have to be considered by the GWR as well, requiring a robustness against the user's positioning in the field of view of the humanoid robot. Second, since both the pose and motion are dependent on the body measurements of the original performer, the expert's exercise cannot be easily used as a reference. This paper tackles the first challenge by designing an architecture that allows for tolerances in translation and rotations regarding the center of the field of view. For the second challenge, we allow the GWR to grow online on incremental data. For evaluation, we created a novel exercise dataset with virtual avatars called the Virtual-Squat dataset. Overall, we claim that our novel architecture based on the GWR can use a learned exercise reference for different body variations through continual online learning, while preventing catastrophic forgetting, enabling for an engaging long-term human-robot interaction with a humanoid robot.

翻译:为了检测和纠正物理演练,开发了一个具有经常性连接、直径内存和新颖子节点机制的成熟时代网络(GWR),以便学习身体运动和姿势的时际关系。一旦练习,每个框架的表面和运动信息就存储在GWR中。对于每一个框架,将当前成形和运动配对与GWR的预测输出进行比较,不仅允许对运动的外形和速度进行反馈。在实际情景中,物理练习由像理疗师这样的专家进行,然后用作像Pepper这样的人形机器人的参考,以便对病人的体外运动进行反馈。但是,这一方法将包含两个挑战:一是人体机器人的距离和用户在摄影机对人形机器人的观察中的位置进行比较,同时允许用户对运动的外观进行反馈。第二,对于人类机器人的外观定位,由于虚拟的外观和运动的直径向性动作,我们之所以要用直径直的外向下,我们无法用直径直的图像来进行数据转换。

相关内容

Source: Apple - iOS 8