题目: Multi-view Knowledge Graph Embedding for Entity Alignment

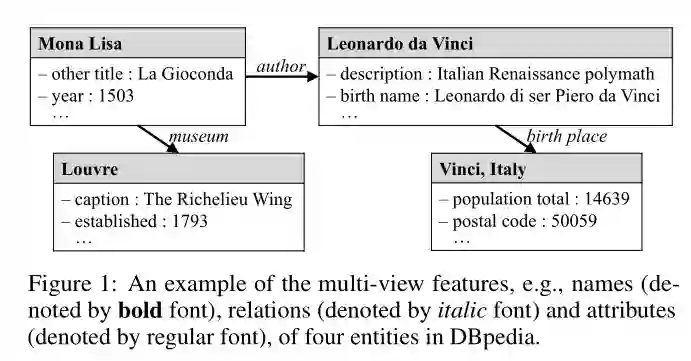

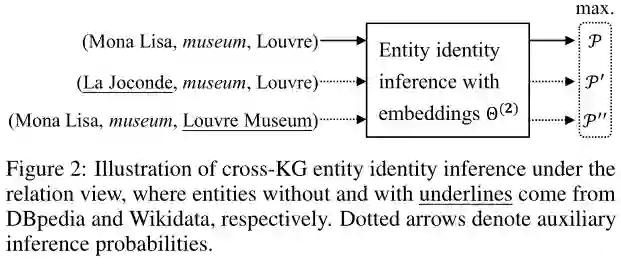

摘要: 我们研究了知识图谱之间基于嵌入的实体对齐问题。之前的研究主要集中在实体的关系结构上。有些还进一步合并了另一种类型的特性,比如属性,以进行细化。然而,大量的实体特征尚未被探索或没有被平等地放在一起处理,这损害了基于嵌入的实体对齐的准确性和鲁棒性。在本文中,我们提出了一个新的框架,统一实体的多个视图来学习嵌入来实现实体对齐。具体来说,我们根据实体名称、关系和属性的视图嵌入实体,并使用几种组合策略。此外,我们设计了一些跨KG推理方法来增强两个KG之间的对齐。我们在真实数据集上的实验表明,所提出的框架显著优于目前最先进的基于嵌入的实体对齐方法。所选择的视图、跨KG推理和组合策略都有助于性能的提高。

成为VIP会员查看完整内容

相关内容

知识图谱(Knowledge Graph),在图书情报界称为知识域可视化或知识领域映射地图,是显示知识发展进程与结构关系的一系列各种不同的图形,用可视化技术描述知识资源及其载体,挖掘、分析、构建、绘制和显示知识及它们之间的相互联系。

知识图谱是通过将应用数学、图形学、信息可视化技术、信息科学等学科的理论与方法与计量学引文分析、共现分析等方法结合,并利用可视化的图谱形象地展示学科的核心结构、发展历史、前沿领域以及整体知识架构达到多学科融合目的的现代理论。它能为学科研究提供切实的、有价值的参考。

专知会员服务

77+阅读 · 2020年6月14日

Arxiv

5+阅读 · 2018年2月3日